この記事に関連するお役立ち資料

AIを活用した業務自動化 事例BOOK

無料ダウンロード

ファインチューニングとは一体何なのか、他の手法との違いはどこにあるのか、気になっているところだと思います。この主な原因は、事前学習や追加学習、RAGから転移学習に至るまで周辺の手法が多くあることです。

そこで今回は、ファインチューニングの基本と必要性、仕組みを解説します。また、類似するRAGや転移学習との違いなどにも触れるため、ぜひ参考にしてください。

このように、AIの効果的な導入には、技術的な知識だけでなく、ビジネスニーズと技術的制約のバランスを取る能力が求められます。どうしたら良いのか困ったときには、ぜひ資料もご覧ください。

- ファインチューニングとは

- ファインチューニングの必要性

- ファインチューニングの仕組み

- LLMを用意する

- 事前学習(Pre-training)を行う

- ファインチューニングを行う

- ファインチューニングを人間に例えてみた

- ファインチューニングだけでは企業のAI導入を補えない

- データの質と量

- コスト

- 柔軟性

- ファインチューニング以外の選択肢も持つことが大切

- ファインチューニングとその他の手法との違い

- プロンプトエンジニアリングとの違い

- RAG(Retrieval-Augmented Generation)との違い

- 追加学習との違い

- 転移学習との違い

- AIのファインチューニングにかかる費用/料金の目安

- AIのファインチューニングで学習させるデータの例

- 企業内で蓄積したデータ

- 専門領域に特化したデータ

- 最新情報のデータ

- ファインチューニングを行う4つのメリット

- 生成AIモデルに指向性を与えられる

- 回答精度が向上する

- モデルを使いまわせる

- コストを削減できる

- ファインチューニングにはデメリットも多い

- ファインチューニングの実施は投資対効果で判断

- ファインチューニングに関するFAQ

- 生成AIのファインチューニングとは?

- ファインチューニングに使うデータセットの作り方は?

- ChatGPTのファインチューニングの事例は?

- まとめ

ファインチューニングとは

ファインチューニング(Fine-tuning、微調整)とは、事前学習(Pre-training)された大規模言語モデル(LLM)や生成AI等の訓練済みモデルを、特定のタスクや領域に適応させるために再トレーニングする手法です。

この過程では、モデルの一部または全体のパラメーターを、新しいデータセットを用いて微調整します。学習率を通常よりも小さな値に設定することで、既に調整済みのパラメーターへの影響を最小限に抑えつつ、モデルの性能を目的のタスクに最適化します。

ファインチューニングの必要性

大規模言語モデル(LLM)や事前学習済みの生成AI等のモデルは、膨大なデータを用いて訓練されているため、幅広い知識と言語理解能力を持っています。しかし、この汎用モデルだけでは、各企業が求める特定のタスクや業界固有の要求に最適化されておらず、精度が不十分です。

このような状況下で汎用モデルをそのまま使用すると、以下のような問題に直面します。

不正確または不適切な回答の生成

業界固有の文脈や専門用語の誤解

セキュリティやコンプライアンス上のリスク

ユーザーエクスペリエンスの低下

ファインチューニングを行うことで、この課題を解決し、企業の特定のニーズに合わせてAIモデルを最適化できます。このことから、既存モデルではなくファインチューニングモデルが必要とされているわけです。

ファインチューニングの仕組み

ファインチューニングの仕組みは、以下の3つで成り立っています。

LLMを用意する

事前学習(Pre-training)を行う

ファインチューニングを行う

LLMを用意する

ファインチューニングの第一歩は、適切な大規模言語モデル(LLM)の選択から始まります。自社独自のLLMを開発することは、膨大な時間とリソースを要するため、多くの場合、既存のモデルを活用することが効率的です。

例えば、BERTやGPT-3(Generative Pretrained Transformer)、LaMDA(Language Model for Dialogue Applications)、PaLM(Pathways Language Model)などが広く知られています。このモデルは、すでに膨大なデータで訓練されており、豊富な言語理解能力を持っています。

事前学習(Pre-training)を行う

通常、LLMの事前学習は既に完了しているため、この段階を省略できることが多いです。事前学習済みのモデルは、ChatGPTやClaude等の一般に利用可能なAIサービスとして提供されています。

このモデルは、幅広い一般知識を獲得しており、様々なタスクに対応できる状態です。事前学習済みモデルを使用することで、開発時間を大幅に短縮し、より効率的にAIシステムを構築できます。

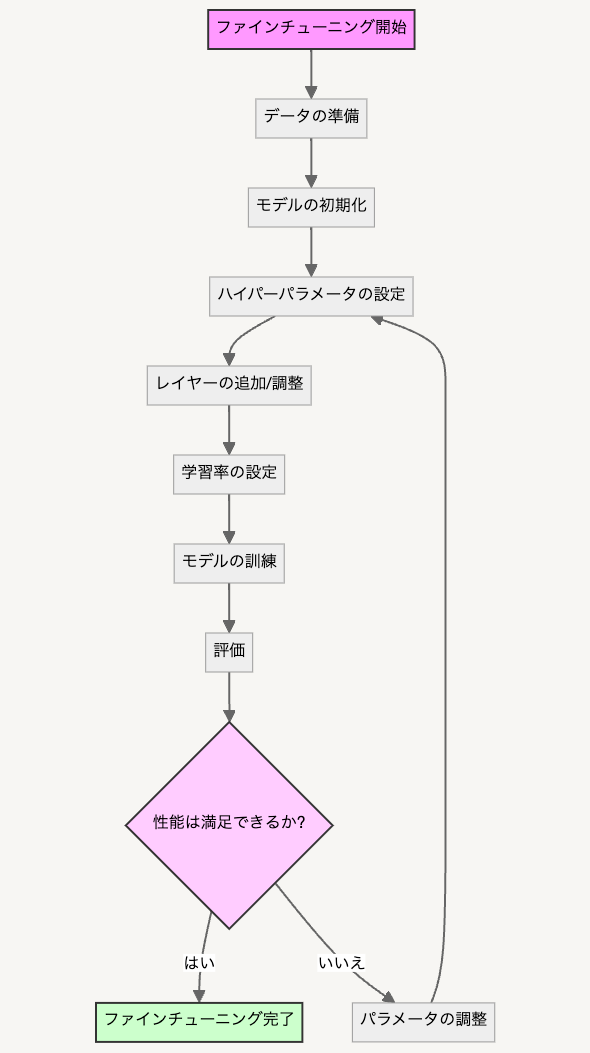

ファインチューニングを行う

ファインチューニングは、選択したLLMを特定のタスクや領域に適応させる過程です。この段階で、モデルに特定の指向性を与え、目的に合わせた出力を生成できるよう調整します。

具体的には、以下のステップを踏みます。

タスク特化型レイヤーの追加

学習率の設定

特定のデータセットでの訓練

性能評価と調整

反復的な改善

このプロセスを通じて、LLMは特定のドメインや用途に最適化され、より精度の高い、目的に即した出力を生成できます。つまり、ファインチューニングはChatGPTやClaudeなどのモデルに指向性を与えるというものだと覚えましょう。

ファインチューニングを人間に例えてみた

ここまで説明した内容ではわかりにくい方もおられるため、人間に例えてみましょう。大規模言語モデル(LLM)を新卒の大学生とするなら、ファインチューニングは特定の職業に特化した専門家へと成長するプロセスに似ています。

例えば、ChatGPTのような事前学習済みのAIモデルを、幅広い知識を持つ新卒者と考えてみましょう。

この新卒者は、大学で様々な分野の基礎知識を身につけていますが、特定の職業に必要な専門的なスキルはまだ全然足りません。ここで、ファインチューニングという手法が登場します。ここでは、新卒者が「プログラマー」として就職し、専門性を高めていく過程に例えることができます。

就職後の数か月間、この新入社員は集中的な研修を受けました。この過程は、AIモデルが特定のタスクや分野に関する新しいデータセットで学習する様子です。大学で学んだ一般的な知識を基礎としつつ、プログラミングに特化した新しい情報を吸収していくわけです。

時間が経つにつれ、新入社員は実際のプロジェクトに参加し、具体的な問題に取り組みます。ファインチューニングされたAIモデルが特定のタスクで精度を向上させていくように、失敗や成功を重ねながら、理論的な知識を実践的なスキルに変換します。

そして、先輩社員からのフィードバックを受け、自分のアプローチを常に改善する様子は、AIモデルが追加のトレーニングデータや調整を通じて性能を向上させる過程です。このプロセスを経て、元新入社員が立派なプログラマーに成長するように、ファインチューニングされたAIモデルも特定のタスクに特化した高性能なツールへと進化するという仕組みです。

ファインチューニングだけでは企業のAI導入を補えない

ファインチューニングは、事前学習済みの大規模言語モデル(LLM)を特定のタスクや領域に適応させる強力な手法です。しかし、企業のAI導入において、ファインチューニングだけでは不十分な場合が多々あります。

その理由は、データの質と量、コスト、そして柔軟性という3つの観点から説明できます。

データの質と量

まず、ファインチューニングには大量の高品質なデータセットが必要です。多くの企業では、このような条件を満たすデータの準備が困難です。

例えば、医療分野での専門的な診断AIを開発する場合、数万件の正確な診断結果と詳細な症例データが要求されます。このようなデータセットの作成には、膨大な時間と労力がかかります。

コスト

次に、コストの問題があります。ファインチューニングは、計算資源を大量に消費するプロセスです。

GPUなどの高性能ハードウェアが必要となり、その運用コストは無視できません。OpenAIのGPT-3モデルをファインチューニングする場合、数千ドルから数万ドルの費用がかかります(あくまで概算)。

柔軟性

さらに、ファインチューニングされたモデルは、新しい情報や変化する要件に対して柔軟性が低いという課題も残ります。例えば、法律や規制が頻繁に更新される分野でAIを活用する場合、モデルの再学習が頻繁に必要となり、維持管理のコストが増大します。

ファインチューニング以外の選択肢も持つことが大切

データの質と量、コスト、そして柔軟性という3つの理由から、多くの企業はRAG(Retrieval-Augmented Generation)アプローチを採用しています。RAGは、既存の大規模言語モデルと企業固有の知識ベースを組み合わせる手法です。

例えば、顧客サポートAIの場合、ChatGPTのような汎用モデルに企業の製品マニュアルや FAQ データベースを組み合わせることで、特定の製品に関する正確な回答を生成できます。

RAGのメリットは、データの更新が簡単で、モデルの再学習が不要な点です。新製品の情報を追加する場合、知識ベースを更新するだけで済みます。また、ファインチューニングと比較して、はるかに少ないデータ量で効果的に機能します。

結局のところ、企業のAI導入は、ファインチューニングとRAGのどちらか一方ではなく、両者を適切に組み合わせることが重要です。例えば、基本的なタスクにはRAGを使用し、高度な分析や予測が必要な場合にはファインチューニングを適用するといった具合です。

このように、AIの効果的な導入には、技術的な知識だけでなく、ビジネスニーズと技術的制約のバランスを取る能力が求められます。どうしたら良いのか困ったときには、ぜひ資料もご覧ください。

ファインチューニングとその他の手法との違い

ここからは、ファインチューニングとその他の手法との違いを以下に分けて紹介します。

プロンプトエンジニアリングとの違い

RAG(Retrieval-Augmented Generation)との違い

追加学習との違い

転移学習との違い

プロンプトエンジニアリングとの違い

プロンプトエンジニアリングとは、事前学習済みモデルの内部構造を変更せずに、入力データ(プロンプト)を設計することで、タスクに対するAIの反応を最適化する手法のことです。

例えば、ChatGPTに対して「あなたは世界一流の料理人です」と指示することで、より専門的な料理のアドバイスを引き出すようなケースが挙げられます。

一方、ファインチューニングは、モデルの内部パラメータ自体を調整し、特定のタスクや領域に特化させる手法です。料理人の例で言えば、実際に料理のトレーニングを受けさせて技術を向上させるようなものです。

プロンプトエンジニアリングが「言葉巧みな指示」であるのに対し、ファインチューニングは「実践的なスキル向上」と捉えることができます。

関連記事:プロンプトエンジニアリングとは?例を交えた設計ポイント

RAG(Retrieval-Augmented Generation)との違い

RAG(Retrieval-Augmented Generation)とは、AIモデルが回答を生成する際に、外部の情報源から関連データを取得し、それを参照しながら出力を行う手法のことです。例えるなら、オペレーターが顧客の質問に答える際に、常に最新のマニュアルを参照しながら回答するようなものです。

これに対し、ファインチューニングは、事前に特定の領域やタスクに関する知識をモデルへ学習させる手法です。RAGが「その場で調べながら答える」アプローチであるのに対し、ファインチューニングは「事前に徹底的に勉強して臨む」アプローチと言えます。

この違いは、即時性と深い専門知識のトレードオフを示しており、用途に応じて適切な手法の選択が必要です。

追加学習との違い

追加学習とは、既存のモデルに新しいデータを順次投入し、継続的に学習を行う手法のことです。例えば、ニュース記事を要約するAIシステムが、日々更新される最新のニュース情報を学習し続けるようなケースで有効です。

一方、ファインチューニングは、特定のタスクや領域に対して集中的に調整を行う手法です。追加学習が「日々の小テスト」のようなものだとすれば、ファインチューニングは「集中的な特訓」に例えることができます。

ファインチューニングは、モデルの基本的な構造を維持しつつ、特定の目的に最適化するため、追加学習よりも急激かつ効果的な性能向上が期待できます。

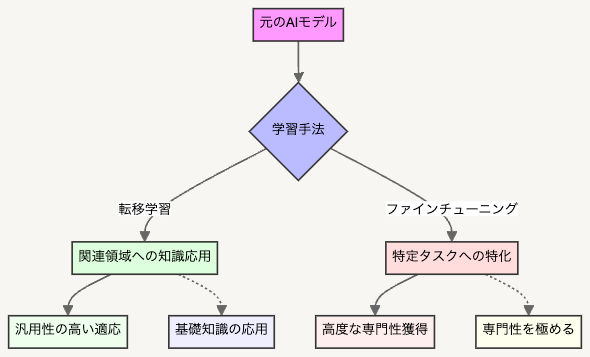

転移学習との違い

転移学習とは、ある領域で学習された知識や技能を、別の関連する領域に適用する技術のことです。例えば、英語の文法を学んだ後に、その知識をフランス語学習に活用するといった具合です。

一方、ファインチューニングは、既存のモデルを特定のタスクに特化させる手法です。転移学習が「基礎知識を応用する」アプローチであるのに対し、ファインチューニングは「専門性を極める」アプローチと言えます。

具体的には、画像認識で学習したモデルを医療画像診断に適用する場合、転移学習では基本的な画像処理能力を活かしつつ医療特有の特徴を学習しますが、ファインチューニングでは医療画像に特化した精密な調整を行います。この違いは、汎用性と専門性のバランスを考慮する上で重要です。

関連記事:転移学習とは?ファインチューニングやRAGとの違い・注意点をわかりやすく解説

AIのファインチューニングにかかる費用/料金の目安

AIのファインチューニングにかかる費用は、プロジェクトの規模や複雑さによって大きく異なります。小規模なプロジェクトでは、ChatGPTのファインチューニングだけを行う場合、比較的低コストで実施できます。

例えば、GPT-3.5-turboモデルを使用する場合、1Mトークンあたり$8の費用と、適切なデータセットの準備だけで済むなどです。しかし、企業が本格的にAIのファインチューニングに取り組む場合、考慮すべき費用項目は多岐にわたります。

項目 | 内容 |

|---|---|

データ収集・前処理 | データ購入、クリーニング・ラベリングなど |

計算リソース | GPUサーバーレンタル、クラウドコンピューティングなど |

人件費 | AIの専門家・エンジニア、プロジェクトマネージャーなど |

ソフトウェア・ツール | 機械学習フレームワーク、開発ツールライセンスなど |

インフラ整備 | サーバー・ストレージ、ネットワーク設備など |

評価・テスト | モデル評価、品質保証テストなど |

運用・メンテナンス | モデル更新・再トレーニング、システム保守など |

この要素を考慮すると、企業におけるAIのファインチューニングプロジェクトの総費用は、数十万円から数千万円と幅広い範囲に及ぶことがあります。

このことから、企業がAIのファインチューニングを検討する際は、単なる技術的な側面だけでなく、ビジネス目標との整合性や、長期的な運用コストも含めた総合的な判断が求められます。。適切な予算配分と、効果的なリソース活用が、成功のポイントとなるでしょう。

AIのファインチューニングで学習させるデータの例

AIのファインチューニングで学習させるデータの例には、以下の3つが挙げられます。

企業内で蓄積したデータ

専門領域に特化したデータ

最新情報のデータ

企業内で蓄積したデータ

企業内で蓄積したデータは、企業特有の知識や経験を反映しており、AIモデルを企業の特定のニーズに合わせて調整する上で利用できます。例えば、顧客対応履歴や製品開発の記録など、企業独自の情報をAIに学習させることで、より精度の高い回答や予測が可能です。

企業内データの活用には、データの品質と量がポイントとなります。十分な量の高品質なデータがあれば、AIモデルの性能を大幅に向上させることが可能です。ただし、データの機密性や個人情報保護の観点から、適切なデータ管理とセキュリティ対策が不可欠です。

専門領域に特化したデータ

専門領域に特化したデータは、特定の分野や業界に関する深い知識と洞察を含んでおり、AIモデルをその領域に最適化するのに役立ちます。例えば、医療分野では、診断記録や医学論文のデータを用いてAIをファインチューニングすることで、より正確な診断支援や治療法の提案が可能になるなどです。

とはいえ、専門データの選択と準備には、その分野の専門家の関与が不可欠です。データの質と量、そして最新性が重要であるほか、画像や音声などのマルチモーダルデータを含めることで、より包括的な学習も検討しましょう。

最新情報のデータ

最新情報のデータは、急速に変化する世界の動向や新しい知識を反映し、AIモデルを常に最新の状態に保つ役割を果たします。ニュース記事や学術論文の最新データを用いると、最新のトレンドや発見に基づいた回答や分析を実現できるといった具合です。

最新データの収集と選別においても、データの信頼性と関連性を確保するため、信頼できるソースからの情報収集と、適切なフィルタリングプロセスが不可欠です。また、RAG(Retrieval-Augmented Generation)などの手法と組み合わせることで、より柔軟で適応性の高いAIシステムの構築も構築できます。

ファインチューニングを行う4つのメリット

ファインチューニングを行うメリットは、以下の4つです。

生成AIモデルに指向性を与えられる

回答精度が向上する

モデルを使いまわせる

コストを削減できる

生成AIモデルに指向性を与えられる

ファインチューニングを通じて、生成AIモデルに特定の思考パターンや知識体系を組み込むことが可能です。ChatGPTに社内データを学習させることで、企業固有の情報や業務プロセスに精通したAIアシスタントを作り出す方法はすでによく知られています。

また、このプロセスは単なる情報の蓄積ではなく、AIに企業文化や意思決定の論理を理解させる深層学習の一形態とも言える重要なものです。

回答精度が向上する

ファインチューニングによって、AIモデルの回答精度を向上させることができます。最新のデータや専門性の高い情報を追加学習させることで、モデルの知識基盤を拡充し、より正確で時宜を得た回答を生成できます。

AIの「転移学習」能力を活用し、既存の知識を新たな文脈に適用する能力を強化する際にも有効です。

モデルを使いまわせる

特定の企業や分野に特化してファインチューニングされたAIモデルは、汎用性を持ちます。金融機関向けにチューニングされたモデルは、リスク分析、顧客サービス、コンプライアンス管理など、多岐にわたるタスクに応用できるといった具合です。

なぜなら、深層学習の層構造がタスク間で、共有可能な特徴表現を学習できるからです。このように、一度の投資で多様な業務改善や効率化を実現できる、コスト効果の高いソリューションとなります。

コストを削減できる

ファインチューニングは、AIの運用コストを削減する戦略的アプローチともなり得ます。GPT-4のような高度なモデルの使用を避け、代わりにGPT-3.5などの比較的軽量なモデルをファインチューニングすることで、同等以上の性能を低コストで実現できるからです。

このように、特定の領域に関する知識を効率的に組み込むファインチューニングは、企業のAI導入における重要な戦略となり得ます。

ファインチューニングにはデメリットも多い

ファインチューニングは、メリットの多い手法ですが、同時に以下のデメリットも存在します。

開発環境の構築と実施にコストがかかる

データセット(量と質)が必要になる

学習内容に過剰反応する可能性がある

ハイパーパラメータの選択が難しい

何度も微調整が必要となる

LLMのアップデートで再学習を求められる

回答の精度は大きく変わらない

このことから、企業がAIを効果的に活用するためには、ファインチューニングだけでなく、RAGや転移学習などの代替手法も含めたアプローチが重要です。詳しくは、下記ページもご覧ください。

関連記事:ファインチューニングのデメリット7選|メリットや他の手法を踏まえた最良の道とは?

ファインチューニングの実施は投資対効果で判断

ファインチューニングには多大なコストと時間がかかるため、慎重な投資対効果の検討が不可欠です。

大量の高品質なデータのデータを収集し、適切にラベリングするだけでも、膨大な人的・金銭的リソースが必要となります。加えて、ファインチューニングされたモデルの性能向上が、投資に見合うものかどうかの判断も重要です。

医療分野での診断支援AIの場合、わずか1%の精度向上が人命に関わるため、高額な投資と透明性の確保が必要かもしれません。一方、一般的な文章生成タスクでは、同程度の投資が必ずしも価値を生まない可能性もあります。

このような理由から、多くの企業はファインチューニングの代替手段、または複合案として、Retrieval-Augmented Generation(RAG)を採用しています。

このことから、ファインチューニングを実施すべきかどうかは、各企業の具体的なニーズ、利用可能なリソース、期待される成果を総合的に評価して判断する必要があるわけです。\

NOVEL株式会社のAIコンサルティングでは、豊富な経験と専門知識を基に、各企業に最適なAI導入戦略を提案します。投資対効果の高い業務を特定し、稟議用の資料作成からご提案も行うため、ぜひお気軽にお声がけください。

ファインチューニングに関するFAQ

最後に、ファインチューニングに関する質問へ回答します。

生成AIのファインチューニングとは?

ファインチューニングに使うデータセットの作り方は?

ChatGPTのファインチューニングの事例は?

生成AIのファインチューニングとは?

生成AIのファインチューニングとは、事前学習済みの大規模言語モデル(LLM)を特定のタスクや領域に適応させる手法のことです。この過程で、モデルは新たなデータセットを用いて追加学習を行い、特定の用途に最適化されます。

ファインチューニングに使うデータセットの作り方は?

ファインチューニングに使用するデータセットの作成では、目的を明確化してそれに沿ったデータを収集することからはじめます。次に、収集したデータの前処理とラベリングを実施し、訓練用・検証用・テスト用の3つを用意する流れです。

この場合、全体の60%を訓練、20%を検証、20%をテスト用とするのが一般的です。最後に、データセットの品質を確認して完了となります。

ChatGPTのファインチューニングの事例は?

ChatGPTのファインチューニングの事例は、以下が挙げられます。

チャットボットの対応力向上

社内ナレッジベースの訓練

文章作成・要約・翻訳性能の向上

自社に最適化した営業支援の構築

システム開発・改修のコスト最適化と自動化

詳しくは、下記ページもご覧ください。

関連記事:日本企業におけるChatGPT・APIの活用・導入事例40選|導入効果と注意点も解説

まとめ

ファインチューニングは、事前学習済みの大規模言語モデル(LLM)を特定のタスクや領域に適応させる手法です。この技術により、企業は自社のニーズに合わせてAIモデルを最適化し、業務効率の向上や顧客サービスの改善を実現できます。

しかし、ファインチューニングの実施には、高品質なデータセットの準備や計算リソースの確保など、多くの課題があります。また、投資対効果の観点から、必ずしもすべての場合にファインチューニングが最適な選択肢とは限りません。

生成AIの活用方法に悩んだ際は、NOVEL株式会社のAIコンサルティングサービスをぜひご利用ください。豊富な経験と専門知識を基に、各企業に最適なAI導入戦略を提案します。

この記事に関連するお役立ち資料を無料ダウンロード

AIを活用した業務自動化 事例BOOK

AI技術を活用した社内業務効率化の基本から、実際の導入ステップまでをわかりやすく解説しています。

下記フォームにご記入下さい。(30秒)

テックユニットは、下記のような方におすすめできるサービスです。

お気軽にご相談ください。

・開発リソースの確保に困っている方

・企業の新規事業ご担当者様

・保守運用を移管したい方

・開発の引き継ぎを依頼したい方

おすすめの記事

関連する記事はこちら

生成AIを用いたアンケート分析:メリットと活用のコツ

アンケート分析は、顧客の声を理解し事業戦略を立てる上で欠かせません。しかし、従来の人手によるアンケート分析では、大量データの処理や複雑な分析に膨大な時間と労力が必要です。本記事では、これらの課題を解決する生成AIとChatGPTを活用したア...

生成AIで顧客分析・顧客フィードバック分析を効率化!導入手順とメリットとは?

顧客の満足度向上と長期的な関係構築は、どの企業にとっても重要な目標です。これを実現するには、顧客のニーズを正確に把握する必要があります。しかし、従来の分析手法では、顧客分析に時間と労力がかかりすぎてしまいます。そこで注目を集めているのが、生...

【2024年最新】AI/生成AIのパーソナライズ事例と導入ステップを徹底解説

「生成AIを活用したいけど、どうすればパーソナライズできるのか分からない」「生成AIのパーソナライズ導入にはリスクがあるのではないか」というお悩みはありませんか?生成AIを用いたパーソナライズは、顧客体験の改善や業務プロセスの最適化など、多...

業務に使える文書作成の生成AIツール10選|活用例や注意点も解説

ビジネスの現場では文書を作成する機会が多く、「文書作成に時間がかかりすぎる」「クオリティの高い文章を効率的に作成したい」などの悩みは尽きません。しかし、一般的なAIライティングツールでは、ビジネスの現場で求められる高度な要求に応えきれないこ...

生成AIでRFP(提案依頼書)への回答を効率化!メリットと具体的な手順を解説

RFP(提案依頼書)の回答作成において、「時間がかかりすぎる」「ミスが心配」「もっと効率的に作成できないか」といった悩みを抱えている方も多いのではないでしょうか。RFPには一定の形式や構造があり、テンプレートで作成できることから、生成AIと...

生成AIによる報告書の自動作成|選定基準や導入効果、注意点について

報告書で作成に時間がかかり、ミスの心配も付きまとう…そのような悩みを抱えていませんか?生成AIを活用すれば、作成時間の大幅短縮やコスト削減、さらには品質の向上まで実現可能です。本記事では、AIを使った報告書の自動作成について、そのメリットや...

コンサル必見!リサーチレポートの作成を生成AIで効率化する方法

リサーチレポート作成は、膨大な情報を収集・分析し、まとめ上げる骨の折れる仕事です。生成AIを使えば、人間の専門知識や洞察力を組み合わせることで、より効率的で質の高いリサーチレポートを作成できます。本記事では、コンサルがリサーチレポート作成に...

生成AIで取扱説明書の作成を効率化!手順とメリット、注意点とは?

「取扱説明書の作成に時間がかかりすぎる」「マニュアルの内容にばらつきがある」というお悩みはありませんか?生成AIを活用することで、取扱説明書の作成時間を大幅に短縮し、内容の質の向上と均一化を図ることができます。ただし、情報の正確性や著作権の...

生成AI/chatGPTを用いて競合調査/市場調査を効率化する方法

競合調査や市場調査は、ビジネス戦略を立てる上で不可欠な作業です。しかし、膨大な情報を収集し、分析するのは時間と労力のかかる作業。そんな中、生成AIやChatGPTの登場により、この調査プロセスを大幅に効率化できる可能性が生まれました。本記事...

生成AIで求人原稿の作成を効率化|具体的な方法について

「求人原稿の作成に時間がかかりすぎる」「魅力的な求人原稿を書くのが難しい」など、求人原稿の作成は多くの企業にとって時間と労力を要する作業です。この作業で生成AIを使うことで、採用活動の効率化、業務負担の軽減、求人情報のクオリティ向上が実現で...

研修教材作成に生成AIを導入するメリット・注意点とは?

「研修教材の作成に時間がかかりすぎる」「効果的な教材を作るのが難しい」など、研修教材の作成は時間と労力がかかり、かつ効果的な内容を盛り込むのは容易ではありません。生成AIを活用した研修教材作成であれば、AIの提案を基に人間が内容を調整するこ...

生成AIで提案書/営業資料を作成する方法【Dify活用編】

ビジネスの世界で、提案書や営業資料の作成は欠かせない重要な業務です。しかし、多くの場合、この作業には相当な時間と労力が必要となります。締め切りに追われ、内容の充実よりも完成を急ぐことも少なくありません。本記事では、生成AIを活用した提案書/...

人気記事ランキング

おすすめ記事